M

MemoriLabs/Memori

Memori is agent-native memory infrastructure. A LLM-agnostic layer that turns agent execution and conversation into structured, persistent state for production systems.

agentagent-memoryaiai-memoryaiagentawesomechatgptllmlong-short-term-memorymemori-aimemorymemory-managementmemory-mcpopenclaw-memorypythonragstate-managementstatefultypescript

⭐

15.2k

Stars

🔱

2.5k

Forks

👁

63

Watchers

📋

14

Issues

PythonNOASSERTION创建于 2025/7/24更新于 今天

README

由 Gemini 翻译整理

Memori 是原生代理(Agent-native)内存基础设施。它是一个与 LLM 无关(LLM-agnostic)的层,能够将代理的执行过程和对话转换为生产系统中结构化的持久状态。

不仅是记住代理“说了什么”,更要记住代理“做了什么”。

Memori 可以接入你现有的软件和基础设施。它与 LLM、数据库和框架无关,并能无缝集成到你现有的架构中。

→ Memori Cloud — 零配置。获取 API Key,几分钟内即可开始构建。

选择性能卓越的内存方案。

入门指南

安装

TypeScript SDK

npm install @memorilabs/memori

Python SDK

pip install memori

快速开始

在 app.memorilabs.ai 注册并获取 Memori API Key,然后即可开始构建。完整文档请参考:memorilabs.ai/docs/memori-cloud/。

设置 MEMORI_API_KEY 和你的 LLM API key(例如 OPENAI_API_KEY),然后:

TypeScript SDK

import { OpenAI } from 'openai';

import { Memori } from '@memorilabs/memori';

// 需要在环境变量中设置 MEMORI_API_KEY 和 OPENAI_API_KEY

const client = new OpenAI();

const mem = new Memori().llm

.register(client)

.attribution('user_123', 'support_agent');

async function main() {

await client.chat.completions.create({

model: 'gpt-4o-mini',

messages: [{ role: 'user', content: 'My favorite color is blue.' }],

});

// 对话将在后台自动持久化并被召回。

const response = await client.chat.completions.create({

model: 'gpt-4o-mini',

messages: [{ role: 'user', content: "What's my favorite color?" }],

});

// Memori 会回忆起你最喜欢的颜色是蓝色。

}

Python SDK

from memori import Memori

from openai import OpenAI

# 需要在环境变量中设置 MEMORI_API_KEY 和 OPENAI_API_KEY

client = OpenAI()

mem = Memori().llm.register(client)

mem.attribution(entity_id="user_123", process_id="support_agent")

response = client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": "My favorite color is blue."}]

)

# 对话自动持久化并被召回。

response = client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": "What's my favorite color?"}]

)

# Memori 会回忆起你最喜欢的颜色是蓝色。

探索内存

使用 Dashboard —— 查看内存、分析、Playground 以及管理 API Keys。

[!TIP] 想要使用自己的数据库?请查看 Memori BYODB 文档: https://memorilabs.ai/docs/memori-byodb/。 如需用于开发的临时 BYODB 数据库,请参考 TiDB Zero 配置指南: docs/memori-byodb/databases/tidb.mdx。

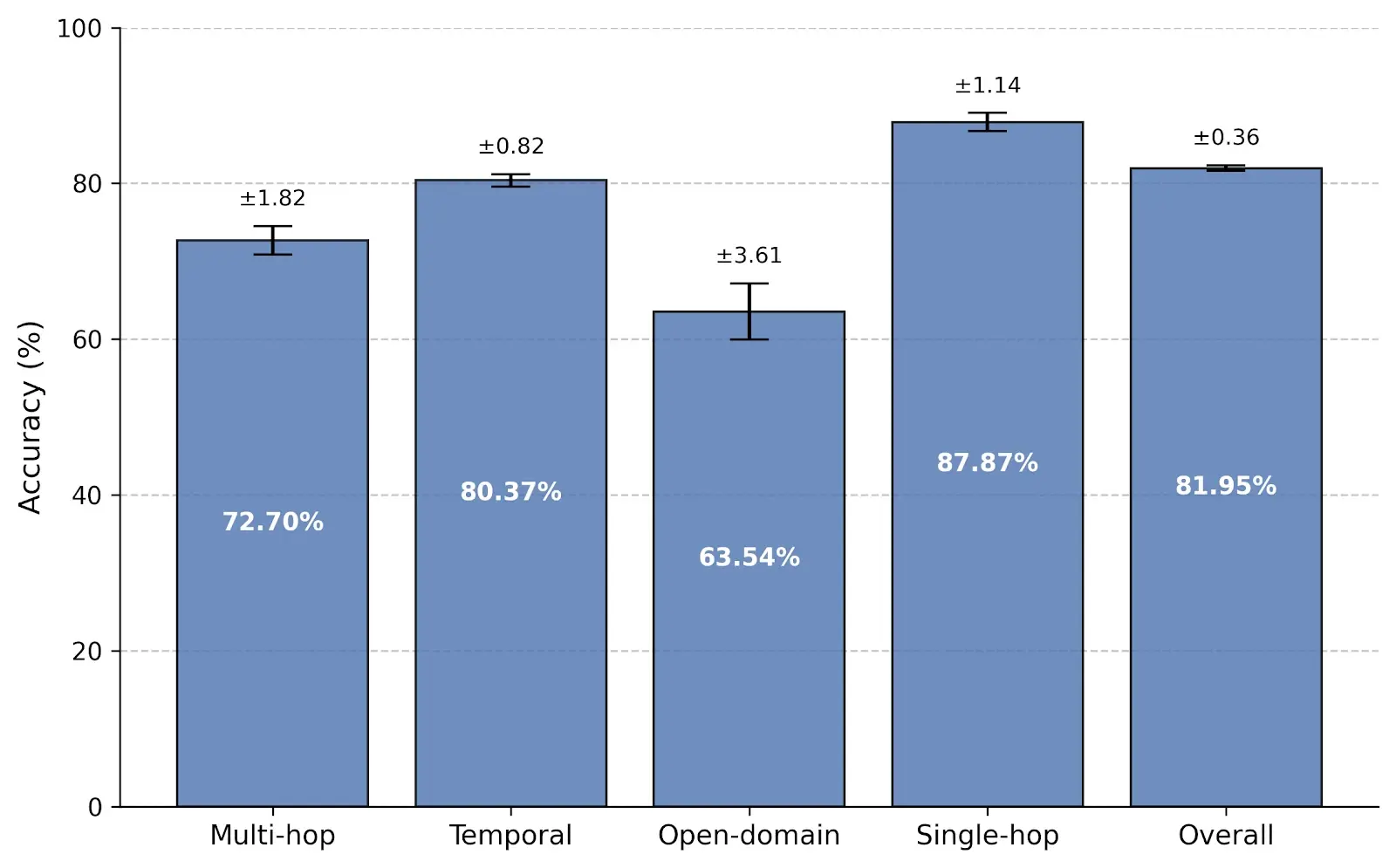

LoCoMo 基准测试

Memori 在用于长对话内存的 LoCoMo 基准测试中进行了评估,在平均每个查询使用 1,294 tokens 的情况下,实现了 81.95% 的整体准确率。这仅占全上下文占用空间的 4.97%,证明了结构化内存无需在每次请求中强制使用大量提示词(Prompt)即可保持推理质量。

与其他基于检索的内存系统相比,Memori 的表现优于 Zep、LangMem 和 Mem0,同时相比 Zep 减少了约 67% 的提示词大小,且比全上下文提示词(full-context prompting)降低了超过 20 倍 的上下文成本。

OpenClaw (网关持久化内存)

默认情况下,OpenClaw 代理在会话间会丢失所有信息。Memori 插件解决了这个问题。它在每一轮对话后自动捕获来自对话和代理执行的结构化内存——包括工具调用、决策和结果——并使其可供代理按需召回。

无需更改你的代理代码或提示词。该插件挂载在 OpenClaw 的生命周期中,因此你只需安装该插件,即可获得结构化内存、代理控制的召回功能以及高级增强功能(Advanced Augmentation)。

openclaw plugins install @memorilabs/openclaw-memori

openclaw plugins enable openclaw-memori

openclaw memori init \

--api-key "YOUR_MEMORI_API_KEY" \

--entity-id "your-app-user-id" \

--project-id "my-project"

openclaw gateway restart

有关设置和配置,请参阅 OpenClaw 快速开始。有关架构和生命周期的详细信息,请参阅 OpenClaw 概述。

Hermes Agent (持久化内存提供者)

Memori 也作为 Hermes Agent 的内存提供者发布。它捕获已完成的对话。